Sportvorhersagen

Ladevorgang...

Ladevorgang...

Hinter jeder KI-gestützten Fussballprognose steckt Mathematik. Nicht die abgehobene Sorte, die nur Professoren verstehen, sondern angewandte Statistik, die jeder lernen kann. Wer dieses Fundament versteht, kann die Qualität von KI-Tipps besser einschätzen, eigene Analysen durchführen und fundierte Entscheidungen treffen. Das Ziel ist nicht, selbst zum Statistiker zu werden, sondern die Sprache zu verstehen, in der KI-Systeme kommunizieren.

Viele Wettende scheuen die Mathematik. Sie vertrauen lieber auf Bauchgefühl, auf Expertenmeinungen oder auf das, was sie im Stadion gesehen haben. Das ist verständlich, aber langfristig ein Nachteil. Die Buchmacher verlassen sich nicht auf Bauchgefühl. Sie rechnen. Und wer gegen Rechner gewinnen will, muss selbst rechnen können oder zumindest verstehen, wie die Rechnung funktioniert.

Die statistischen Methoden, die bei Fussballprognosen zum Einsatz kommen, sind keine Erfindung der letzten Jahre. Viele davon existieren seit dem 19. Jahrhundert. Was sich geändert hat, ist die Verfügbarkeit von Daten und die Rechenleistung, um diese Methoden auf grosse Datensätze anzuwenden. KI-Systeme automatisieren letztlich das, was Statistiker früher mühsam per Hand berechneten. Das Grundprinzip bleibt jedoch dasselbe: aus vergangenen Daten Muster erkennen und diese Muster auf zukünftige Ereignisse übertragen.

Der Fussball eignet sich besonders gut für statistische Analyse. Es gibt klare Regeln, messbare Ergebnisse und eine Fülle von Daten. Jedes Spiel produziert dutzende von Datenpunkten: Tore, Schüsse, Pässe, Fouls, Eckbälle, Ballbesitz. Diese Daten werden seit Jahren systematisch erfasst und sind weitgehend öffentlich zugänglich. Das ist ein Schatz für jeden, der bereit ist, ihn zu heben.

Für Wettende ist statistisches Verständnis aus einem einfachen Grund unverzichtbar: Buchmacher nutzen dieselben Methoden. Sie berechnen ihre Quoten auf Basis statistischer Modelle. Wer diese Modelle versteht, kann einschätzen, wo die Buchmacher möglicherweise falsch liegen. Dort liegt Value. Die Statistik ist also nicht nur ein akademisches Werkzeug, sondern ein praktischer Schlüssel zu profitablen Wetten.

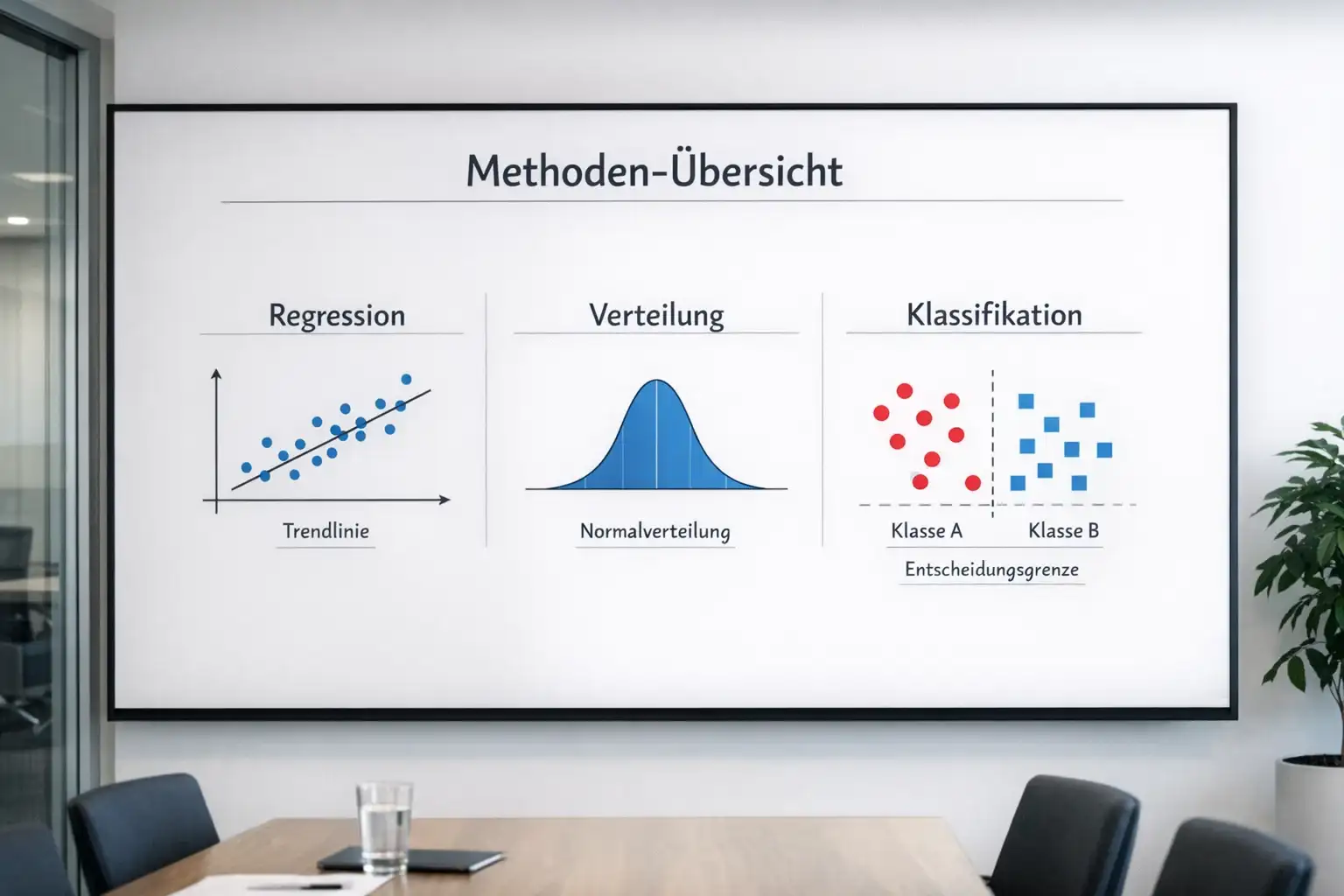

Welche statistischen Methoden nutzt KI?

Die Bandbreite der statistischen Verfahren, die in KI-gestützten Fussballprognosen zum Einsatz kommen, ist beeindruckend. Von einfachen Durchschnittsberechnungen bis hin zu komplexen neuronalen Netzen reicht das Spektrum. Jede Methode hat ihre Stärken und Schwächen, und die besten KI-Systeme kombinieren mehrere Ansätze.

Am Anfang steht die deskriptive Statistik. Sie beschreibt, was war: Wie viele Tore hat ein Team durchschnittlich geschossen? Wie sieht die Heimbilanz aus? Wie oft hat Team A gegen Team B gewonnen? Diese Grunddaten bilden das Fundament jeder weiteren Analyse. Ohne saubere deskriptive Statistik ist keine valide Prognose möglich. Die Qualität der Rohdaten bestimmt die Qualität der Vorhersage.

Die inferentielle Statistik geht einen Schritt weiter. Sie zieht Schlüsse aus den Daten und trifft Aussagen über zukünftige Ereignisse. Hier kommen Wahrscheinlichkeitsverteilungen ins Spiel, Konfidenzintervalle und Hypothesentests. Die inferentielle Statistik fragt nicht nur, was war, sondern was daraus folgt. Wenn Team A in den letzten 20 Heimspielen 15 Mal gewonnen hat, wie wahrscheinlich ist ein Heimsieg im nächsten Spiel?

Regressionsanalysen identifizieren Zusammenhänge zwischen Variablen. Welchen Einfluss hat die Passgenauigkeit auf den Torerfolg? Wie stark korreliert der xG-Wert mit dem tatsächlichen Endergebnis? Die Regression quantifiziert diese Beziehungen und macht sie nutzbar für Prognosen. KI-Systeme nutzen Regression, um die wichtigsten Einflussfaktoren auf den Spielausgang zu identifizieren und zu gewichten.

Klassifikationsalgorithmen ordnen Spiele in Kategorien ein: Heimsieg, Unentschieden, Auswärtssieg. Oder: Über 2,5 Tore, Unter 2,5 Tore. Diese Algorithmen lernen aus historischen Daten, welche Merkmalskombinationen zu welchen Ergebnissen führen. Entscheidungsbäume, Random Forests und Support Vector Machines sind typische Vertreter dieser Kategorie.

Zeitreihenanalysen berücksichtigen die zeitliche Dimension der Daten. Die Form eines Teams ist nicht statisch, sondern entwickelt sich. Zeitreihenmodelle erfassen diese Dynamik und gewichten aktuelle Leistungen höher als ältere. Für Fussballprognosen ist das entscheidend, weil die Formkurve oft wichtiger ist als die Saisonstatistik.

Die Poisson-Verteilung: Das Arbeitstier der Fussballstatistik

Wenn es einen statistischen Ansatz gibt, der die Fussballanalyse dominiert, dann ist es die Poisson-Verteilung. Dieses mathematische Modell, benannt nach dem französischen Mathematiker Siméon Denis Poisson, beschreibt die Wahrscheinlichkeit, dass eine bestimmte Anzahl von Ereignissen in einem festen Zeitraum eintritt. Für Fussballtore ist das wie geschaffen.

Die Geschichte der Poisson-Verteilung im Fussball reicht Jahrzehnte zurück. Schon in den 1950er Jahren nutzten britische Statistiker das Modell, um Spielausgänge vorherzusagen. Seitdem hat sich die Methode als Standardwerkzeug etabliert. Buchmacher nutzen sie zur Quotenberechnung, Analysten zur Spielbewertung, KI-Systeme als Basiskomponente komplexerer Modelle.

Die Grundannahme ist einfach: Tore fallen unabhängig voneinander und mit einer bestimmten durchschnittlichen Rate. Wenn ein Team im Schnitt 1,5 Tore pro Heimspiel schiesst, kann die Poisson-Verteilung berechnen, wie wahrscheinlich 0, 1, 2, 3 oder mehr Tore in einem konkreten Spiel sind. Diese Wahrscheinlichkeiten lassen sich dann in Wettquoten umrechnen. Der Zusammenhang ist direkt: Eine Wahrscheinlichkeit von 25 Prozent entspricht einer fairen Quote von 4,00.

Die Formel selbst sieht auf den ersten Blick einschüchternd aus, ist aber in der Anwendung simpel. Man braucht nur den Erwartungswert, also die durchschnittliche Torzahl. Excel und jede Statistiksoftware haben eingebaute Poisson-Funktionen. Ein paar Klicks, und man hat eine vollständige Wahrscheinlichkeitsverteilung für die Tore eines Teams.

In der Praxis funktioniert das so: Man ermittelt die durchschnittlichen Heimtore des Heimteams und die durchschnittlichen Auswärtstore des Auswärtsteams. Diese Werte werden möglicherweise noch angepasst, etwa durch Berücksichtigung der Defensivstärke des Gegners oder der aktuellen Form. Dann berechnet man für beide Teams die Poisson-Verteilungen und kombiniert sie zu einer Ergebnismatrix. Diese Matrix zeigt die Wahrscheinlichkeit für jedes mögliche Endergebnis.

Ein konkretes Beispiel: Dortmund spielt zu Hause gegen Schalke. Dortmund schiesst im Schnitt 2,0 Heimtore, Schalke 1,0 Auswärtstore. Die Poisson-Verteilung für Dortmund ergibt: 0 Tore mit 13,5 Prozent Wahrscheinlichkeit, 1 Tor mit 27,1 Prozent, 2 Tore mit 27,1 Prozent, 3 Tore mit 18,0 Prozent. Für Schalke: 0 Tore mit 36,8 Prozent, 1 Tor mit 36,8 Prozent, 2 Tore mit 18,4 Prozent. Die Kombination ergibt: 1:0 ist mit etwa 10 Prozent das wahrscheinlichste einzelne Ergebnis, gefolgt von 2:0 und 2:1.

Die Grenzen der Poisson-Verteilung sind bekannt. Sie unterstellt Unabhängigkeit der Tore, was nicht immer zutrifft. Ein frühes Tor verändert die Spieldynamik. Defensive Teams spielen nach Führung noch defensiver, offensive Teams nach Rückstand noch offensiver. Ausserdem berücksichtigt das Grundmodell keine tagesaktuellen Faktoren wie Verletzungen oder Motivation. KI-Systeme nutzen die Poisson-Verteilung deshalb als Ausgangspunkt und ergänzen sie um zusätzliche Modellkomponenten.

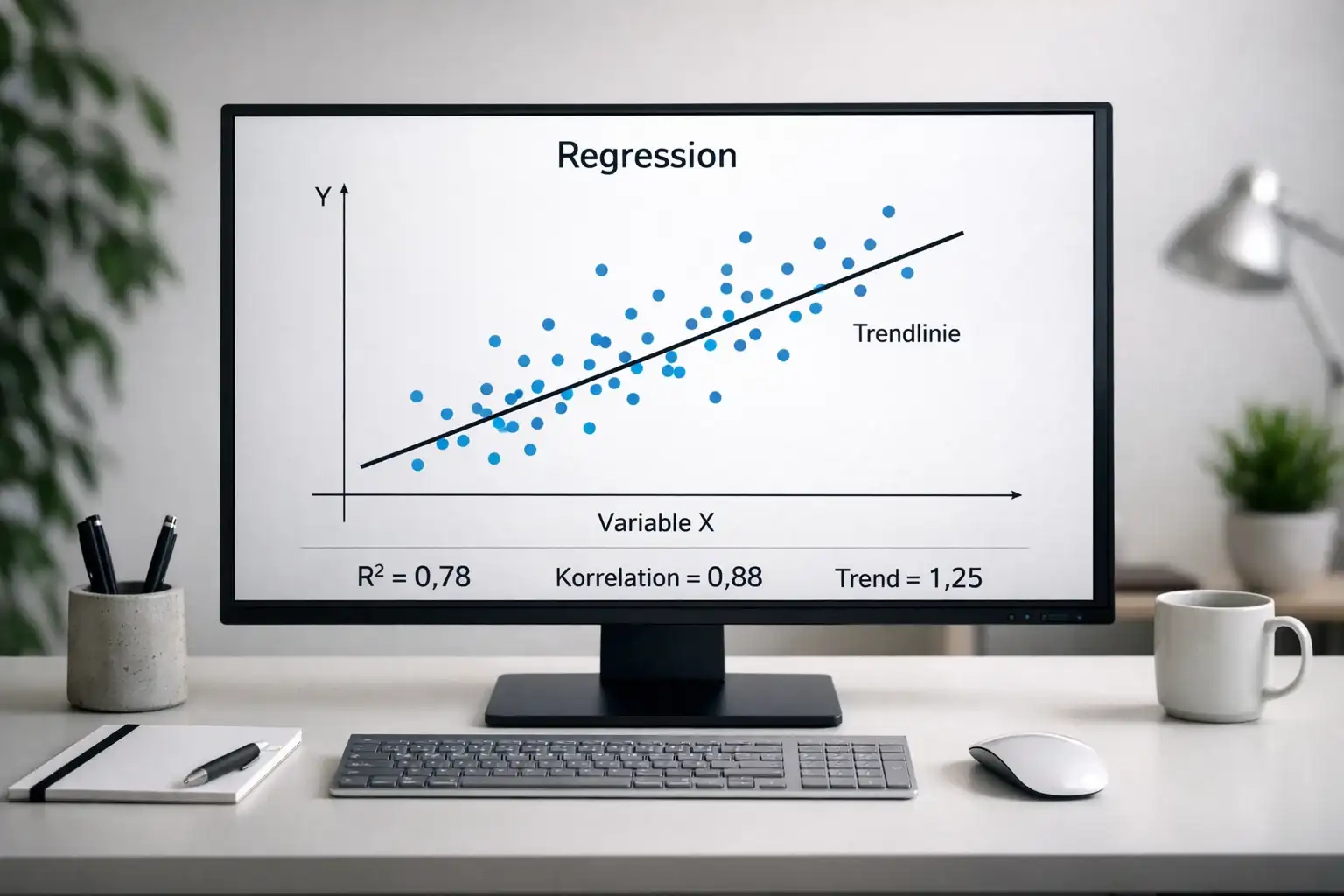

Regression: Zusammenhänge quantifizieren

Die Regressionsanalyse ist das Schweizer Taschenmesser der Statistik. Sie quantifiziert Zusammenhänge zwischen einer abhängigen Variable, etwa dem Spielausgang, und einer oder mehreren unabhängigen Variablen, etwa Ballbesitz, Schüsse aufs Tor oder xG-Wert. Das Ergebnis ist eine mathematische Formel, die Vorhersagen ermöglicht.

Das Konzept ist intuitiv verständlich. Man sucht nach der besten Geraden oder Kurve, die durch eine Punktwolke von Datenpunkten verläuft. Diese Linie minimiert die Abstände zwischen den tatsächlichen Werten und den vorhergesagten Werten. Im Fussballkontext könnte das bedeuten: Man trägt für jedes Spiel den xG-Wert auf der x-Achse und die tatsächlich geschossenen Tore auf der y-Achse auf. Die Regressionsgerade zeigt dann den durchschnittlichen Zusammenhang zwischen beiden Grössen.

Die einfache lineare Regression modelliert den Zusammenhang zwischen zwei Variablen. Man könnte beispielsweise untersuchen, wie stark der xG-Wert die tatsächlich geschossenen Tore vorhersagt. Die Regression liefert dann eine Gleichung der Form: Tore gleich a plus b mal xG. Der Koeffizient b zeigt, wie stark sich die Tore verändern, wenn der xG-Wert um eine Einheit steigt. Das Bestimmtheitsmass R-Quadrat zeigt, wie viel der Variation in den Toren durch den xG-Wert erklärt wird.

Die multiple Regression erweitert diesen Ansatz auf mehrere unabhängige Variablen gleichzeitig. In der Fussballanalyse ist das Standard, weil viele Faktoren den Spielausgang beeinflussen. Ein typisches Modell könnte xG, Ballbesitz, Passgenauigkeit, Formkurve und Heimvorteil als Prädiktoren enthalten. Die Regression gewichtet jeden Faktor automatisch nach seiner Erklärungskraft.

Die logistische Regression ist besonders relevant für Sportwetten, weil sie Wahrscheinlichkeiten für kategoriale Ergebnisse liefert. Statt einen kontinuierlichen Wert wie Tore vorherzusagen, berechnet sie die Wahrscheinlichkeit für Heimsieg, Unentschieden oder Auswärtssieg. Diese Wahrscheinlichkeiten können direkt mit Buchmacherquoten verglichen werden, um Value zu identifizieren.

Die praktische Durchführung einer Regressionsanalyse erfordert Daten und Software. Excel kann einfache Regressionen berechnen, für komplexere Modelle sind spezialisierte Tools wie R oder Python besser geeignet. Wichtig ist die Datenqualität: Je mehr historische Spiele in die Analyse einfliessen, desto stabiler werden die Koeffizienten. Eine Regression auf Basis von zehn Spielen ist wenig aussagekräftig. Hundert Spiele sind besser, tausend noch besser.

Ein häufiger Fehler bei der Regressionsanalyse ist die Überanpassung. Wenn man zu viele Variablen in das Modell aufnimmt, passt es perfekt zu den historischen Daten, versagt aber bei der Vorhersage neuer Spiele. Das Modell hat dann das Rauschen gelernt, nicht das Signal. Gute KI-Systeme nutzen Techniken wie Kreuzvalidierung, um Überanpassung zu vermeiden.

Statistische Signifikanz: Wann ist ein Muster echt?

Jeder, der Fussballdaten analysiert, kennt das Phänomen: Man findet ein scheinbar interessantes Muster. Team A gewinnt 80 Prozent seiner Spiele, wenn es vorher zwei Tage Pause hatte. Ist das ein echter Zusammenhang oder nur Zufall? Die Frage nach der statistischen Signifikanz ist fundamental für jede seriöse Analyse.

Statistische Signifikanz misst, wie wahrscheinlich ein beobachtetes Ergebnis durch Zufall entstanden sein könnte. Der p-Wert quantifiziert diese Wahrscheinlichkeit. Ein p-Wert von 0,05 bedeutet: Wenn es keinen echten Zusammenhang gibt, würde man dieses oder ein extremeres Ergebnis in 5 Prozent der Fälle trotzdem beobachten. Konventionell gilt ein p-Wert unter 0,05 als signifikant.

Für Fussballanalysen ist diese Schwelle problematisch. Die Stichproben sind oft klein. Ein Team spielt etwa 34 Ligaspiele pro Saison, vielleicht noch ein paar Pokalspiele. Aus so wenigen Datenpunkten lassen sich selten statistisch signifikante Muster ableiten. Die Varianz im Fussball ist zu gross, die Ereignisse zu selten.

Ein praktisches Beispiel verdeutlicht das Problem. Angenommen, ein Tipp-Dienst behauptet, eine Trefferquote von 60 Prozent zu haben, basierend auf 50 Tipps. Bei 50 Tipps und einer fairen Münzwurf-Wahrscheinlichkeit von 50 Prozent würde man etwa 25 Treffer erwarten. Die beobachteten 30 Treffer liegen darüber, aber ist der Unterschied signifikant? Ein statistischer Test zeigt: Mit einem p-Wert von etwa 0,10 ist das Ergebnis nicht signifikant auf dem 5-Prozent-Niveau. Die beobachtete Überlegenheit könnte also reiner Zufall sein.

Die Konsequenz für Wettende: Kurzfristige Erfolgsmuster sind mit Vorsicht zu geniessen. Ein Tipp-Dienst, der in einem Monat 70 Prozent Trefferquote hatte, ist nicht unbedingt besser als einer mit 50 Prozent. Die Stichprobe ist zu klein für belastbare Schlüsse. Erst über hunderte oder tausende Tipps hinweg kristallisieren sich echte Qualitätsunterschiede heraus.

KI-Systeme haben hier einen Vorteil: Sie können riesige Datenmengen analysieren und so statistisch belastbarere Muster finden. Wenn ein Algorithmus auf zehntausend historischen Spielen trainiert wurde, sind die gefundenen Zusammenhänge wahrscheinlich echt. Trotzdem bleibt Vorsicht geboten. Auch grosse Datensätze können zufällige Muster enthalten, besonders wenn man viele Variablen gleichzeitig testet.

Historische Daten richtig interpretieren

Daten sind das Rohmaterial jeder statistischen Analyse. Doch Daten allein sagen nichts. Erst die Interpretation macht sie nützlich. Und bei dieser Interpretation lauern zahlreiche Fallstricke, die selbst erfahrene Analysten in die Irre führen können.

Die schiere Menge verfügbarer Daten kann trügerisch sein. Mehr Daten bedeuten nicht automatisch bessere Analysen. Wenn die Datenqualität schlecht ist, verstärkt eine grössere Datenmenge nur die Fehler. Und selbst bei guter Qualität muss man wissen, welche Daten relevant sind und welche nur Rauschen produzieren. Die Kunst liegt in der Auswahl und Gewichtung, nicht in der blossen Anhäufung.

Der erste Fallstrick ist die Verwechslung von Korrelation und Kausalität. Wenn zwei Variablen zusammen auftreten, bedeutet das nicht, dass eine die andere verursacht. Ein klassisches Beispiel aus dem Sport: Teams, die mehr Ballbesitz haben, gewinnen häufiger. Aber verursacht Ballbesitz den Sieg? Oder haben gewinnende Teams einfach mehr Ballbesitz, weil der Gegner nach Rückstand offensiver spielt? Die Kausalrichtung ist oft unklar, und statistische Modelle können sie nicht klären.

Der zweite Fallstrick ist der Survivorship Bias, der Überlebensirrtum. Wenn man nur erfolgreiche Wettstrategien analysiert, übersieht man die vielen gescheiterten Strategien, die ähnlich aussahen. Ein Tipp-Dienst, der drei Jahre überlebt hat, wirkt erfolgreich. Aber vielleicht gab es hundert ähnliche Dienste, die nach einem Jahr pleite waren. Die Überlebenden sind nicht unbedingt besser, sondern hatten vielleicht nur mehr Glück.

Der dritte Fallstrick ist die Stichprobenverzerrung. Wenn die Daten nicht repräsentativ sind, führt die Analyse in die Irre. Ein Modell, das nur auf Bundesliga-Daten trainiert wurde, funktioniert möglicherweise nicht für die Serie A. Ein Modell, das nur Topspiele analysiert, versagt bei Spielen von Abstiegskandidaten. Die Übertragbarkeit der Ergebnisse muss immer kritisch hinterfragt werden.

Der vierte Fallstrick ist die Vernachlässigung des Kontexts. Historische Daten zeigen, was war, aber nicht, warum es so war. Ein Team, das in der letzten Saison 70 Punkte holte, ist nicht automatisch genauso stark wie ein Team, das in einer anderen Saison 70 Punkte holte. Die Ligastärke variiert, Teams verändern sich, der Fussball entwickelt sich. Statistische Modelle, die den Kontext ignorieren, produzieren verzerrte Prognosen.

Gute KI-Systeme versuchen, diese Fallstricke zu vermeiden. Sie nutzen grosse, diverse Datensätze. Sie unterscheiden zwischen Korrelation und Kausalität, soweit das möglich ist. Sie aktualisieren ihre Modelle regelmässig, um Veränderungen im Fussball zu erfassen. Aber keine KI ist perfekt. Die kritische Interpretation der Ergebnisse bleibt Aufgabe des Menschen.

Eigene statistische Analysen durchführen

Wer tiefer in die Materie einsteigen will, kann eigene statistische Analysen durchführen. Das erfordert keine Statistik-Promotion, sondern nur die Bereitschaft, etwas Zeit zu investieren und grundlegende Werkzeuge zu erlernen.

Excel ist der Einstiegspunkt für die meisten. Die Software hat eingebaute Funktionen für Poisson-Berechnungen, Regressionen und grundlegende Statistiken. Mit etwas Übung lässt sich ein eigenes Prognosemodell aufbauen, das Wahrscheinlichkeiten für verschiedene Spielausgänge berechnet. Der Aufwand für die Erstellung einer guten Excel-Vorlage zahlt sich schnell aus, weil die Berechnungen dann automatisiert ablaufen.

Google Sheets bietet ähnliche Funktionalität wie Excel, mit dem Vorteil, dass die Dateien online zugänglich sind und automatisch gespeichert werden. Für kollaborative Projekte oder den Zugriff von verschiedenen Geräten ist das praktisch.

R ist die nächste Stufe. Diese kostenlose Statistiksoftware ist mächtiger als Excel, aber auch komplexer. Die Lernkurve ist steiler, aber die Möglichkeiten sind nahezu unbegrenzt. R hat Pakete für jede erdenkliche statistische Methode, von einfacher Regression bis zu komplexen Machine-Learning-Algorithmen. Für Fussballanalysen gibt es spezialisierte Pakete, die den Einstieg erleichtern.

Python ist die Alternative zu R, mit dem Vorteil, dass es eine vollwertige Programmiersprache ist. Bibliotheken wie pandas für Datenverarbeitung, scikit-learn für Machine Learning und matplotlib für Visualisierung machen Python zu einem mächtigen Werkzeug für Sportanalysen. Wer sowieso programmieren lernen will, ist mit Python gut beraten.

Unabhängig vom gewählten Werkzeug gilt: Beginne einfach. Ein simples Poisson-Modell ist ein guter Startpunkt. Dann schrittweise Erweiterungen: Anpassung für Heimvorteil, Berücksichtigung der Form, Integration von xG-Daten. Jede Erweiterung sollte geprüft werden: Verbessert sie die Vorhersagegenauigkeit, oder fügt sie nur Komplexität hinzu?

Die Datenquellen für eigene Analysen sind vielfältig. FBref, Understat, WhoScored bieten umfassende Statistiken kostenlos an. Für historische Daten gibt es spezialisierte Websites wie Football-Data.co.uk, die Ergebnisse und Quoten vergangener Saisons bereitstellen. Mit diesen Daten lässt sich ein eigenes Modell trainieren und testen.

Das Testen ist entscheidend. Ein Modell, das vergangene Spiele perfekt erklärt, ist wertlos, wenn es zukünftige Spiele nicht vorhersagen kann. Die Standardmethode ist die Kreuzvalidierung: Man teilt die Daten in einen Trainings- und einen Testsatz. Das Modell wird auf dem Trainingssatz trainiert und auf dem Testsatz geprüft. Nur wenn es auf dem Testsatz gut abschneidet, ist es brauchbar.

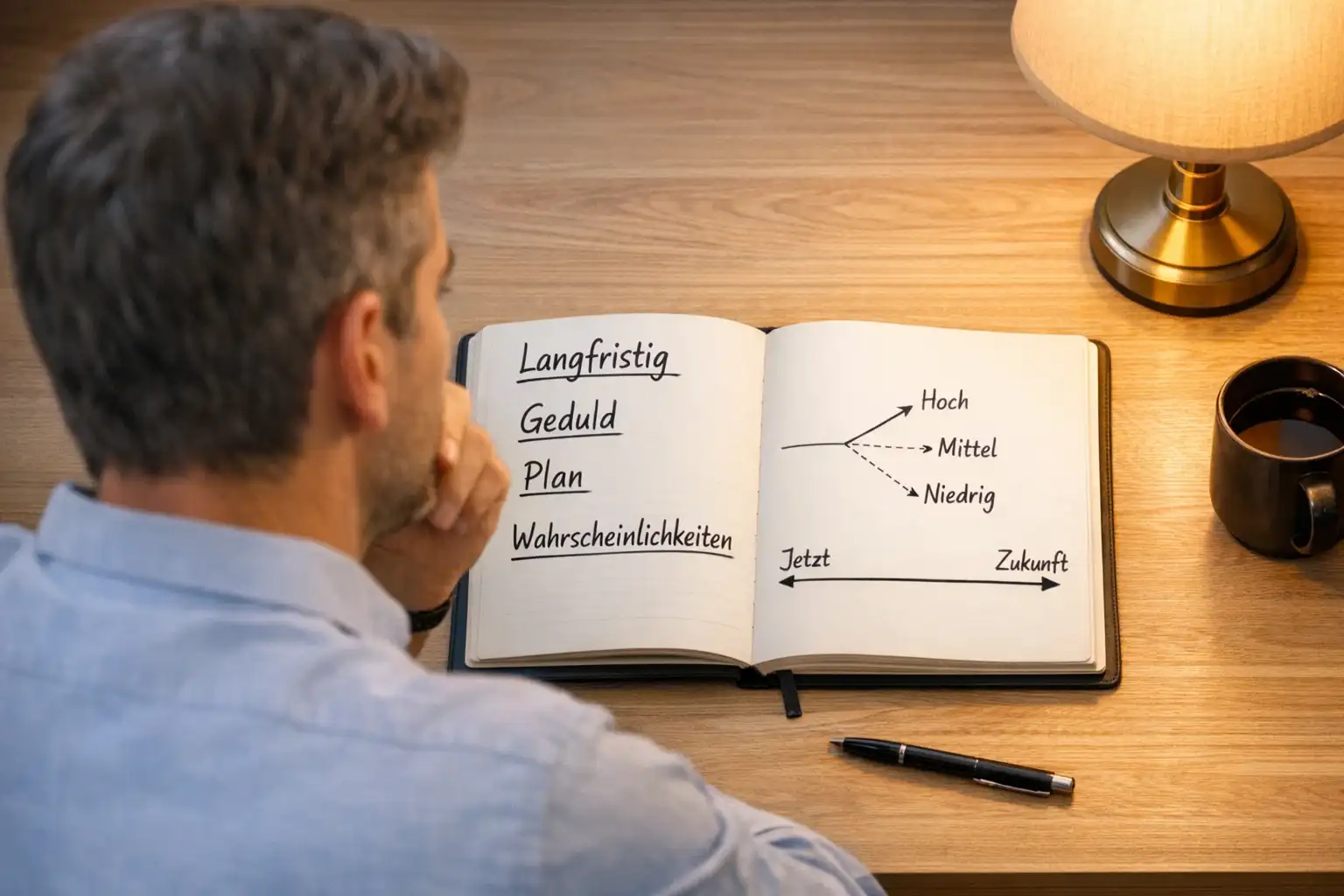

Statistisches Denken für bessere Wettentscheidungen

Statistisches Denken ist mehr als das Anwenden von Formeln. Es ist eine Denkweise, die Unsicherheit akzeptiert, Wahrscheinlichkeiten versteht und langfristig denkt. Für Sportwetten ist diese Denkweise Gold wert. Sie unterscheidet den erfolgreichen Wetter vom Gelegenheitsspieler, der auf Dauer verliert.

Der Umstieg von intuitivem zu statistischem Denken ist nicht einfach. Unser Gehirn ist evolutionär darauf programmiert, Muster zu erkennen, auch wo keine sind. Es überschätzt kleine Stichproben und unterschätzt Zufall. Es erinnert sich an Treffer und vergisst Fehlschläge. Statistisches Denken arbeitet gegen diese natürlichen Verzerrungen. Es erfordert bewusste Anstrengung und kontinuierliche Übung.

Das erste Prinzip: Es gibt keine sicheren Wetten. Jede Prognose ist mit Unsicherheit behaftet. Selbst wenn ein Team zu 80 Prozent gewinnen sollte, verliert es in 20 Prozent der Fälle. Statistisches Denken akzeptiert diese Unsicherheit und plant sie ein. Das bedeutet konkret: Bankroll-Management, Einsatzbegrenzung, Diversifikation. Wer alles auf eine Karte setzt, hat das Prinzip nicht verstanden.

Das zweite Prinzip: Der Erwartungswert zählt, nicht das Einzelergebnis. Eine Wette mit positivem Erwartungswert ist gut, auch wenn sie verliert. Eine Wette mit negativem Erwartungswert ist schlecht, auch wenn sie gewinnt. Statistisches Denken bewertet Entscheidungen nach ihrer langfristigen Qualität, nicht nach dem zufälligen Ausgang eines einzelnen Ereignisses.

Das dritte Prinzip: Die Stichprobe bestimmt die Aussagekraft. Zehn Wetten sagen wenig über die Qualität einer Strategie aus. Hundert Wetten sagen mehr. Tausend Wetten sagen viel. Statistisches Denken ist geduldig. Es zieht keine voreiligen Schlüsse aus kleinen Datenmengen und wartet ab, bis die Stichprobe gross genug ist.

Das vierte Prinzip: Varianz ist unvermeidlich. Selbst mit einer perfekten Strategie wird es Phasen geben, in denen die Ergebnisse hinter den Erwartungen zurückbleiben. Statistisches Denken unterscheidet zwischen Pech und systematischen Fehlern. Es passt die Strategie nicht bei jedem Rückschlag an, sondern nur, wenn die Daten einen echten Anpassungsbedarf zeigen.

Das fünfte Prinzip: Modelle sind Vereinfachungen der Realität. Kein statistisches Modell erfasst alle relevanten Faktoren. Statistisches Denken ist bescheiden. Es weiss um die Grenzen der eigenen Modelle und bleibt offen für Informationen, die das Modell nicht berücksichtigt. Die Kombination aus Modell und gesundem Menschenverstand ist oft besser als beides allein.

Die Integration statistischen Denkens in die eigene Wettstrategie erfordert Übung. Es ist nicht natürlich, in Wahrscheinlichkeiten zu denken. Menschen neigen dazu, extreme Ergebnisse zu überbewerten und Durchschnittswerte zu unterschätzen. Das bewusste Trainieren statistischer Intuition ist ein langfristiges Projekt, das sich aber auszahlt.

KI-gestützte Value-Tipps sind letztlich das Produkt statistischer Methoden. Wer diese Methoden versteht, kann die Qualität von KI-Tipps besser einschätzen, eigene Analysen durchführen und informierte Entscheidungen treffen. Die Statistik ist keine Garantie für Gewinne, aber sie ist das beste Werkzeug, das wir haben, um die Unsicherheit des Fussballs zu navigieren.

Die Reise in die Welt der Fussballstatistik beginnt mit kleinen Schritten. Ein einfaches Poisson-Modell in Excel ist ein guter Anfang. Von dort aus kann man schrittweise komplexere Methoden erkunden. Das Wichtigste ist nicht, alles sofort zu verstehen, sondern die Bereitschaft, kontinuierlich dazuzulernen. Die statistischen Grundlagen, die heute erlernt werden, bleiben relevant, auch wenn sich die spezifischen KI-Systeme weiterentwickeln. Denn am Ende steht hinter jeder noch so ausgefeilten KI dieselbe Grundlogik: Aus Daten lernen, Muster erkennen, Wahrscheinlichkeiten schätzen. Wer diese Logik verinnerlicht, ist für die Zukunft der Sportwetten gut gerüstet.